Business Development Divisionでデータサイエンティストをしている秋元です。

今回はARISEの画像分析チームが取り組んでいる画像処理技術の一つであるMulti-Object Trackingについて、その評価指標を紹介します。

1.Multi-Object Trackingとは

Multi-Object Tracking(MOT)は、動画の中で移動していく複数の人や物をそれぞれ区別して継続的に追跡する画像処理技術です。技術的には画像処理の基本的な技術の一つである物体認識の応用技術になりますが、静止画の物体認識とは異なり動画中の物体は常に外観が変化し続けることから、非常に難しいタスクとされています。

MOTは研究が盛んな分野であり多くのアルゴリズムが開発されています。広く使われているTracking by Detectionと呼ばれる手法では、まず動画の各フレームから追跡対象の物体を検知し、次にフレーム間で同じ物体に対して同一のIDを割り振っていきます。MOTにおいて動画中の物体の位置は一つの矩形で表され、Bounding Boxと呼ばれます。MOTのモデルは、動画の各フレームで検出された同じ物体のBounding Boxに対して一意なIDを割り振ることによって、物体を「追跡」します。

では、物体を追跡するアルゴリズムの性能はどのように評価されるのでしょうか。

MOTのアルゴリズムの性能は正解データのBounding BoxとIDをモデルの出力と比較することによって評価されるのですが、以下この記事ではMOTでよく使われる評価指標を紹介していきます。

2. MOTでモデルを評価する場合の基本的な考え方(FP/Misses/ID Switch)

機械学習における評価指標といえば、Accuracy,Precision,Recallといった指標がありますが、Multi-Object Trackingにおいても似た名前の評価指標が使われます[1]。まず、MOTでモデルの出力が正しいかどうかをどのようにして判断すべきか、基本的な考え方をおさえておきます。

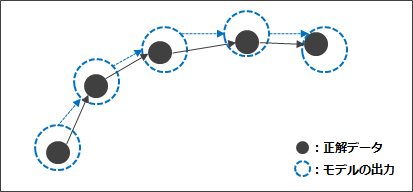

正しい結果

下図のようにモデルの出力が正解データと同じように物体を追跡できた場合、正しい結果とみなします。MOTでは、下図のような一続きの物体の追跡結果をトラックと呼んでいます。

正しくない結果

一方で正しく物体を追跡できない場合として、以下のようなパターンが考えられます。

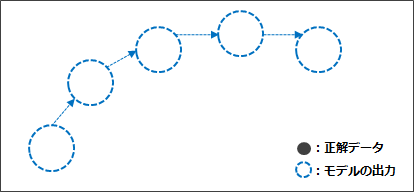

False Positive

下図のように、モデルから出力されたトラックがどの正解データにもマッチしない場合をFalse Positiveと呼びます。

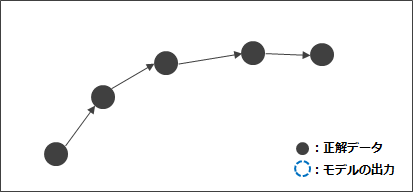

Misses(False Negative)

一方で、正解データに存在するトラックをモデルが予測できなかった場合をMissesと呼びます。

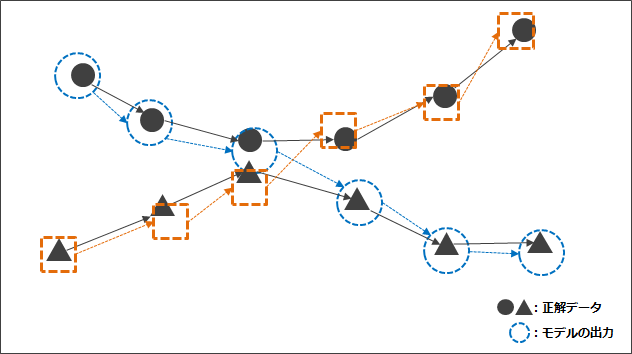

ID Switch(Fragmentation)

最後に、下図のように正解データの2つのトラックが一時交錯する場合には、モデルが追跡対象の物体を誤ってしまうことがあります。MOTでは、この場合をID Switch(Fragmentation)と呼んでいます。

3. Bounding Boxベースの評価指標:Multi-Object Tracking Accuracy

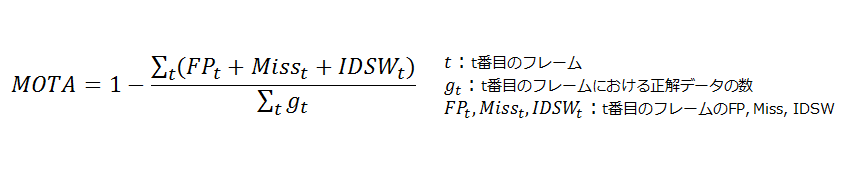

前節で紹介したFalse Positive,Misses,ID Switchに基づいて、MOTでは次式でモデルの精度(Multi-Object Tracking Accuracy; MOTA)を定義しています。

MOTAはMOTA<=1の範囲で値をとり、1に近いほど良いと判断されます。分母は各フレームにおける正解データの総和、分子はフレームごとにFalse Positive,Misses,ID Switchを足し合わせたものです。直感的には、正解データのBounding Boxと予測モデルのBounding Boxが近いほど、また予測モデルのトラックが正解データと一致しているほどMOTAが高くなります。

MOTでは、動画の各フレームから物体認識でBounding Boxを検出し、フレーム間で時系列に沿ってトラックIDを割り振るTracking-by-Detectionの手法が広く使われてきたため、MOTAはそれらのモデルを正しく評価できるように設計されています。

4. IDベースの評価指標:Identification Precision/Recall/F1

MOTAの問題点

MOTAはモデルの出力結果と正解データのトラックの一致度合を数値化したものですが、それではMulti-Object Trackingの性能をうまく表現できない場合もあります。

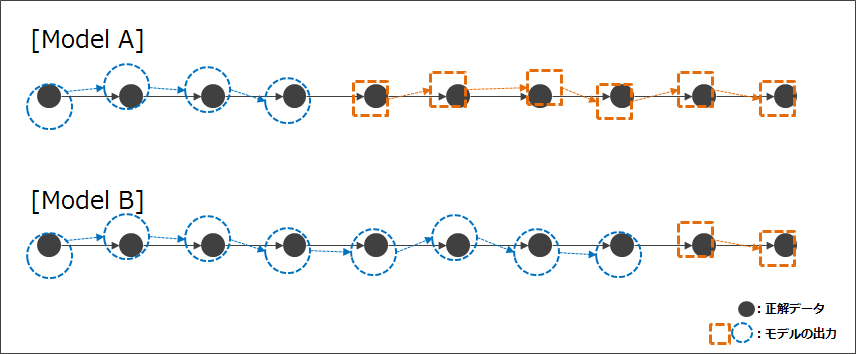

下図では、ある正解データに対するモデルAとモデルBの出力をそれぞれ示しています。MOTとしては、同じ正解データをより長い期間追跡できている方が性能が良いと考えられるので、パターンBの方が性能の良いモデルとしたいところです。

ところが、図中のAとBのモデルをMOTAで評価した場合、どちらのモデルでもID Switchが1回発生しているだけなので、同じ精度(MOTA=0.9)として評価されてしまいます。つまり、MOTAはBounding Boxレベルでの一致度合の評価には適しているのですが、物体をどれくらい長く追跡できているかという点での評価には適していないのです。

トラックのIDから一致度合を算出する評価指標

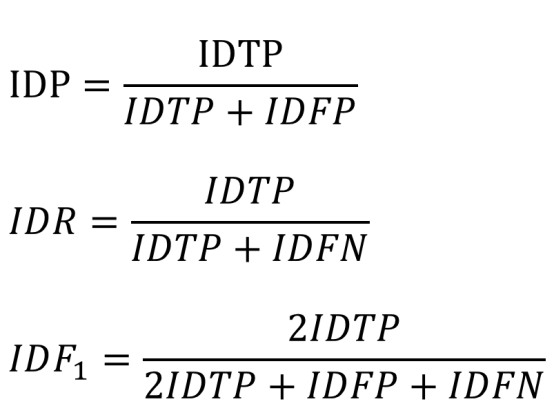

そこで、最近では物体をどれくらい長い間追跡できているかという性能を評価するため、トラックのIDを基準にしたIdentification Precision(IDP),Identification Recall(IDR),Identification F1(IDF1)という指標が合わせて使用されるようになってきました[2]。

MOTAがBounding Boxレベルでの一致度合を計算するのに対して、IDF,IDR,IDF1はトラックのIDレベルでの一致度合に基づいて精度を算出します。

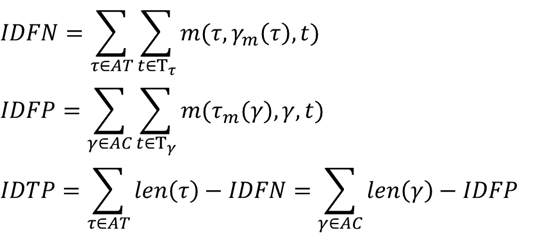

まず正解トラック(τ∈AT)とモデルの出力のトラック(γ∈AC)をFPとFNの総和が最小になるようにマッチングし、正解トラックτにマッチした出力トラックをγm(τ)、出力トラックγにマッチした正解トラックをτm(γ)とあらわします。Tτ,Tγをそれぞれ正解トラックとモデルの出力トラックに含まれるフレーム番号の集合とし、m(x, y, t)は2つのトラックをt番目のフレームで比較した場合に2つのBounding BoxのIoUが閾値以下であれば1を、そうでなければ0を返す関数とします。また、トラックτ,トラックγの長さをそれぞれlen(τ),len(γ)とあらわします。

このとき、IDFN(ID False Negative),IDFP(ID False Positive),IDTP(ID True Positive)を以下のように定義します。

あとは、通常のPrecisionやRecallと同様にIDP,IDR,IDF1を算出すれば、Bounding Boxの一致度合ではなくトラックの長さで性能を評価する指標が下記のように定義されます。

ちなみに、上図のモデルAではIDF1=0.6,モデルBではIDF1=0.8となり、こちらの評価指標では期待した通りモデルBの方が性能が高いと評価されます。

おわりに

この記事では、MOTで広く使われている精度指標MOTAと最近注目されているトラックIDを基準にした精度指標IDP,IDR,IDF1を紹介しました。直感的には、MOTAがトラックのIDをあまり考慮せずにBounding Box間での一致度合を重視しているのに対して、トラックIDを基準にした指標では、まず正解トラックとモデルの出力トラックを一致するものと一致しないものに分類し、それぞれの分類の中でBounding Boxの重なり具合を比較しているという点が異なっています。

Multi-Object Trackingでは、従来Tracking-by-Detectionタイプのモデルが多かったのですが、最近ではDetectionをベースにしないモデルや、逆にDetectionとTrackingを一体化したようなモデルも出てきています[3][4]。モデルが多様化するにしたがって、評価指標も新しいものが必要になってきているようです。一方で、実務レベルでは処理速度やシステムのアーキテクチャなどの問題でTracking-by-Detectionモデルの方が適している場合もあり、一概に新しいものが良いとも言えません。MOTには,ここで紹介した以外にも様々な評価指標が存在するため、モデルのどの側面を評価したいかによって適切な指標を選択することが重要です。

関連文献

- Bernardin, Keni, and Rainer Stiefelhagen. “Evaluating multiple object tracking performance: the CLEAR MOT metrics.” EURASIP Journal on Image and Video Processing 2008.1 (2008): 1-10.

- Performance Measures and a Data Set for Multi-Target, Multi-Camera Tracking. E. Ristani, F. Solera, R. S. Zou, R. Cucchiara and C. Tomasi. ECCV 2016 Workshop on Benchmarking Multi-Target Tracking.

- Bergmann, Philipp, Tim Meinhardt, and Laura Leal-Taixe. “Tracking without bells and whistles.” Proceedings of the IEEE international conference on computer vision. 2019.

- Zhou, Xingyi, Vladlen Koltun, and Philipp Krähenbühl. “Tracking Objects as Points.” arXiv preprint arXiv:2004.01177 (2020).